3D-POP – Tierverhalten per KI erforschen

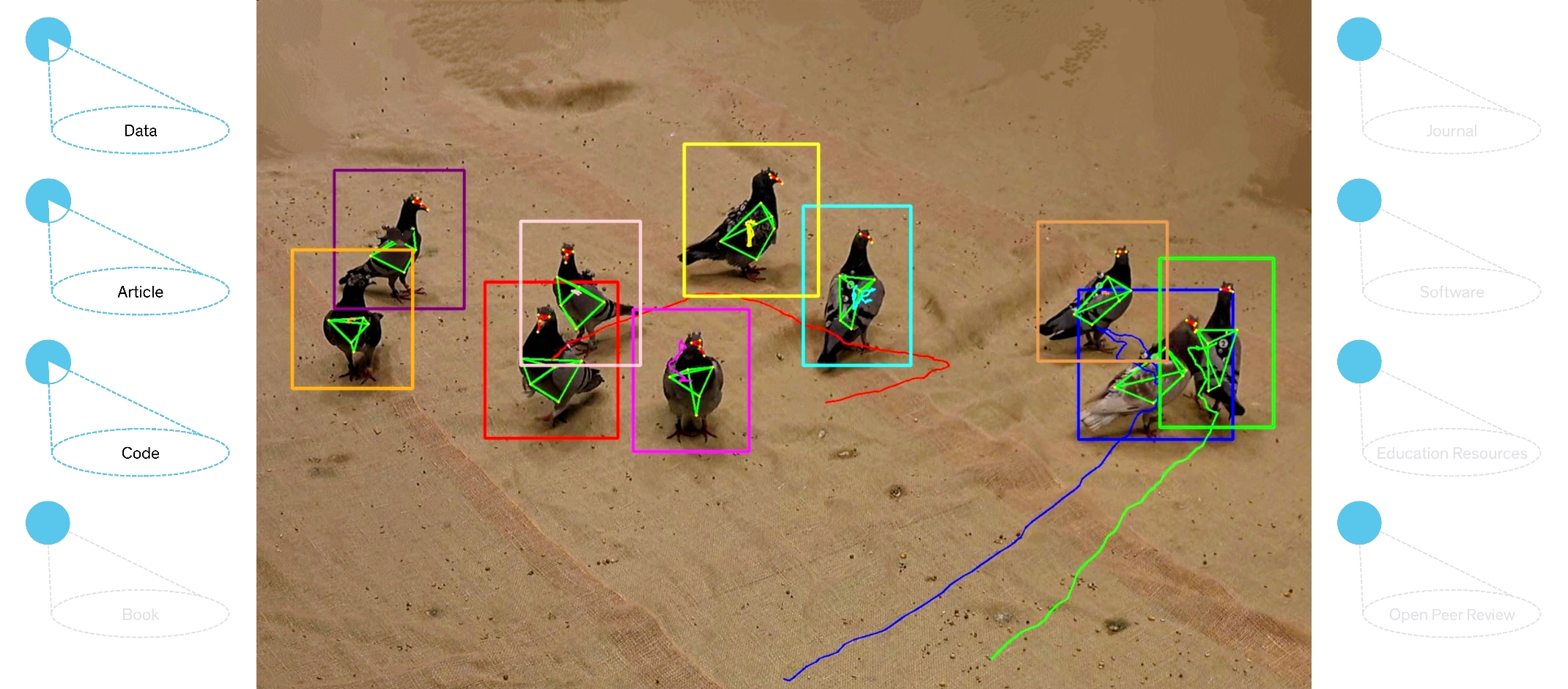

Informationen über die Körperhaltung von Tieren und ihre Bewegungen im dreidimensionalen Raum aus Videoaufnahmen gewinnen, ohne die Tiere mit Markierungen versehen zu müssen oder mühsam Bild für Bild per Hand auszuwerten? Fortschritte im Bereich der Künstlichen Intelligenz (KI) und der Computer Vision machen genau das möglich. Damit eine KI das Verhalten der Tiere bestimmen kann, muss sie zuvor jedoch „lernen“, wie dieses genau aussieht. Dafür bedarf es umfangreicher Trainingsdaten, welche die Tiere in einer Vielzahl möglicher Situationen und aus verschiedenen Winkeln zeigen und das abgebildete Verhalten zuverlässig beschreiben. ExpertInnen sprechen von annotierten Daten.

Mit 3D-POP (kurz für 3D-Posture of Pigeons) stellen Alex Chan und Hemal Naik vom Konstanzer Exzellenzcluster „Centre for the Advanced Study of Collective Behaviour” einen freien Trainingsdatensatz aus etwa 300.000 annotierten Einzelbildern von sich frei bewegenden Tauben zur Verfügung. Für jedes Bild enthält der Datensatz Informationen zur Körperhaltung, Bewegungsbahn und Identität der Tiere. In ihrer Begleitpublikation zum Datensatz beschreiben sie außerdem eine Methode, die es erlaubt, umfangreiche annotierte Datensätze wie 3D-POP halbautomatisiert zu erstellen.

Der Artikel zur halbautomatisierten Erstellung des 3D-POP-Datensatzes ist frei zugänglich.

Der annotierte Trainingsdatensatz 3D-POP (doi: 10.17617/3.HPBBC7) kann im Forschungsdaten-Repositorium der Max Plank Gesellschaft (EDMOND) kostenlos herunter geladen werden.

Die Annotations-Pipeline inklusive Anwendungsbeispiel steht im zugehörigen GitHub-Verzeichnis zur freien Verfügung.